IT職への登竜門、「基本情報技術者試験(FE)」。 多くのIT分野を志す人が通る道ですが、弊社でも、この資格取得を基礎力を養う良いきっかけとして活用しています。

「さくっと合格しました!」とかっこよく言いたいところですが、実は私、一度不合格を経験しています。

今回は、社内での取り組みから、私が一度の失敗を経てどのようにリカバリーし、合格を勝ち取ったのか。実際に役立ったツールや勉強法とあわせてシェアします。

1. なぜ「基本情報」を学ぶのか

そもそも、なぜ私たちが業務の合間を縫ってまでFE取得を目指すのか。それは単なる「資格取得」がゴールではないからです。

基本情報技術者試験は、特定の言語や技術に偏らず、ITの基礎を体系的に固めるために最適な資格です。私たちSE(システムエンジニア)にとって、技術力はもちろん大切ですが、それ以上に求められるのが「顧客への価値提供」です。

【私たちが目指すSE像】 業務・システムへの深い理解を基盤とし、商談や要件定義のヒアリングにおいて、お客様の課題やニーズを的確に引き出し、効果的な提案を行える人材。

この土台を作るために、基礎知識の習得は避けて通れない道だと考えています。

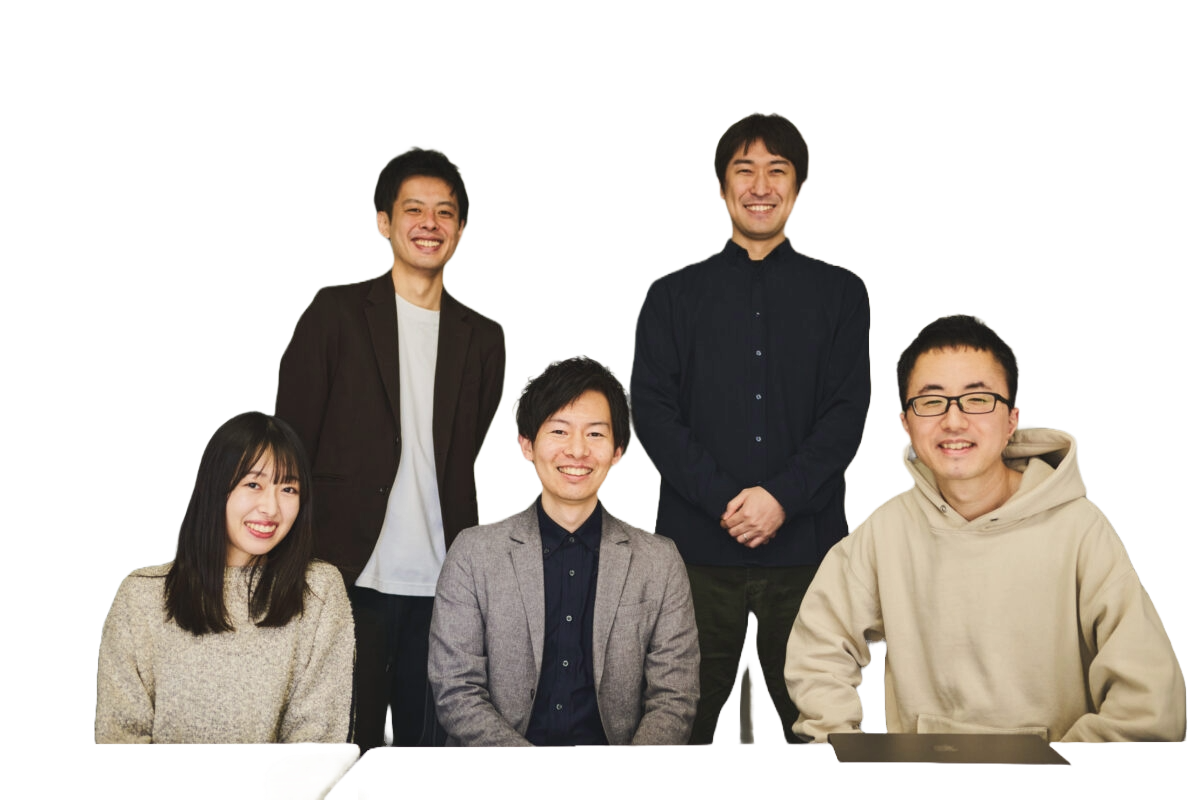

2. スタートは「社内勉強会」から

孤独な戦いになりがちな資格勉強ですが、弊社ではチーム単位での活動として組織的に取り組んでいます。

具体的には、毎週木曜日の17:00〜18:00を勉強会の時間として定例化。 業務の手を一旦止め、会議室やオンラインでメンバーが集まり、集中して学習する時間を確保しています。

この時間は単にテキストを読むだけでなく、わからない用語を教え合ったり、「この知識、実務のあの場面で使えるね」といった議論を交わしたりと、チームならではのシナジーが生まれる場です。 「毎週木曜日は勉強の日」というリズムができたおかげで、業務多忙な中でも学習習慣を途切れさせずに、基礎知識を体系的にインプットすることができました。

3. まさかの結果…!1回目の受験

勉強会で基礎を固め、意気揚々と挑んだ1回目の試験。 結果はパソコンの画面ですぐに表示されるのですが、その時のショックといったらありませんでした。

【1回目のスコア】

| 科目 | スコア | 合格ライン | 結果 |

|---|---|---|---|

| 科目A(知識) | 575点 | 600点 | 不合格 |

| 科目B(技能) | 705点 | 600点 | 合格 |

「え、勉強会であれだけやったのに、科目A(知識系)で落ちた…!?」

科目B(アルゴリズム)はクリアしていましたが、科目Aがあと25点足りませんでした。 勉強会で「理解」はしていても、試験本番で正解を選び抜くための個人の「演習量」が足りていなかったことを痛感しました。

4. リベンジへの対策と2回目の受験

この悔しさをバネに、「次は絶対に受かってやる!」と奮起。 勉強会で培った基礎理解をベースに、個人の弱点をつぶすために以下の「2つの神ツール」を徹底的にやり込みました。

① 科目A対策:王道にして最強「過去問道場」

知識不足を補うため、隙間時間はすべてこれに費やしました。解説が丁寧なので、間違えた理由をその場で理解し、あやふやな知識を確実なものにしていきました。

基本情報技術者試験ドットコム(過去問道場) www.fe-siken.com

② 科目B対策:動画で「型」の再確認

科目Bは合格点でしたが、油断せず時短で復習するために動画を活用しました。アルゴリズムのトレース(変数の値の変化を追うこと)のコツが凝縮されており、効率的に解法を復習できました。

【科目B】アルゴリズム問題をたった1動画で対策_基本情報技術者試験 www.youtube.com

そして迎えた2回目の試験。 社内メンバーの応援を背に、やるべきことはすべてやって挑みました。

【2回目のスコア】

| 科目 | スコア | 前回比 | 結果 |

|---|---|---|---|

| 科目A(知識) | 655点 | +80点 | 合格 |

| 科目B(技能) | 650点 | - | 合格 |

無事、合格ラインをクリア! 勉強会でのインプットと、個人の徹底的なアウトプットがうまく噛み合った結果だと思います。

まとめ

一度不合格になったからこそ言えますが、基本情報技術者試験は「学ぶ環境と正しいツールがあれば、必ず受かる試験」です。

今回得た知識は、ゴールではなくスタートです。 社内勉強会で得た知見と合格の実績を自信に変え、これからは「お客様の課題を的確に捉え、最適なシステムを提案できるSE」として、日々の業務で価値を発揮していきたいと思います。

これから受験を目指す皆さんも、ぜひ諦めずに挑戦し続けてください!